2.09. Проверка значимости и подбор модели с использованием коэффициентов . детерминации. Информационные критерии

Ранее мы неоднократно задавались вопросом о том, как следует интерпретировать значения коэффициента детерминации ![]() С точки зрения их близости к нулю или, напротив, их близости к единице.

С точки зрения их близости к нулю или, напротив, их близости к единице.

Естественным было бы построение статистической Процедуры проверки значимости линейной связи между переменными, Основанной на значениях коэффициента детерминации ![]() — ведь

— ведь ![]() является статистикой, поскольку значения этой случайной величины вычисляются по данным наблюдений. Теперь мы в состоянии построить такую статистическую процедуру.

является статистикой, поскольку значения этой случайной величины вычисляются по данным наблюдений. Теперь мы в состоянии построить такую статистическую процедуру.

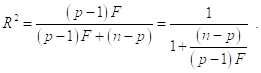

Представим ![]() - статистику критерия проверки значимости регрессии в целом в виде

- статистику критерия проверки значимости регрессии в целом в виде

![]()

Отсюда находим:

![]()

Большим значениям статистики ![]() Соответствуют и большие значения статистики

Соответствуют и большие значения статистики ![]() , так что гипотеза

, так что гипотеза ![]() , отвергаемая при

, отвергаемая при ![]() =

=![]() , должна отвергаться при выполнении неравенства

, должна отвергаться при выполнении неравенства ![]() , где

, где

При этом, вероятность ошибочного отклонения гипотезы ![]() по-прежнему равна

по-прежнему равна ![]() .

.

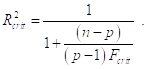

Интересно вычислить Критические значения ![]() При

При ![]() для различного количества наблюдений.

для различного количества наблюдений.

Ограничимся здесь Простой Линейной регрессией ![]() , так что

, так что

В зависимости от количества наблюдений ![]() , получаем следующие критические значения

, получаем следующие критические значения ![]() :

:

|

N |

3 |

4 |

10 |

20 |

30 |

40 |

60 |

120 |

500 |

|

R2crit |

0.910 |

0.720 |

0.383 |

0.200 |

0.130 |

0.097 |

0.065 |

0.032 |

0.008 |

Иначе говоря, при большом количестве наблюдений даже весьма малые отклонения наблюдаемого значения ![]() От нуля оказываются достаточными для того, чтобы признать значимость регрессии, т. е. статистическую значимость коэффициента при содержательной объясняющей переменной.

От нуля оказываются достаточными для того, чтобы признать значимость регрессии, т. е. статистическую значимость коэффициента при содержательной объясняющей переменной.

Поскольку же значение ![]() равно при

равно при ![]() квадрату выборочного коэффициента корреляции между объясняемой и (нетривиальной) объясняющей переменными, то аналогичный вывод справедлив и в отношении величины этого коэффициента корреляции, только получаемые результаты еще более впечатляющи:

квадрату выборочного коэффициента корреляции между объясняемой и (нетривиальной) объясняющей переменными, то аналогичный вывод справедлив и в отношении величины этого коэффициента корреляции, только получаемые результаты еще более впечатляющи:

|

N |

3 |

4 |

10 |

20 |

30 |

40 |

60 |

120 |

500 |

|

|Rxy|Crit |

0.953 |

0.848 |

0.618 |

0.447 |

0.360 |

0.311 |

0.254 |

0.179 |

0.089 |

Если сравнивать модели по величине коэффициента детерминации R2, то с этой точки зрения полная модель всегда лучше (точнее, не хуже) редуцированной — значение R2 в полной модели всегда не меньше, чем в редуцированной, просто потому, что В полной модели остаточная сумма квадратов не может быть больше, чем в редуцированной.

Действительно, в полной модели с ![]() объясняющими переменными минимизируется сумма

объясняющими переменными минимизируется сумма

![]()

По всем возможным значениям коэффициентов ![]() . Если мы рассмотрим редуцированную модель, например, без

. Если мы рассмотрим редуцированную модель, например, без ![]() -ой объясняющей переменной, то в этом случае минимизируется сумма

-ой объясняющей переменной, то в этом случае минимизируется сумма

![]()

По всем возможным значениям коэффициентов ![]() , что равносильно минимизации первой суммы по всем возможным значениям

, что равносильно минимизации первой суммы по всем возможным значениям ![]() при фиксированном значении

при фиксированном значении ![]() . Но получаемый при этом минимум не может быть больше чем минимум, получаемый при минимизации первой суммы по всем возможным значениям

. Но получаемый при этом минимум не может быть больше чем минимум, получаемый при минимизации первой суммы по всем возможным значениям![]() , включая и все возможные значения

, включая и все возможные значения ![]() . Последнее означает, что

. Последнее означает, что ![]() в полной модели не может быть меньше, чем в редуцированной модели. Поскольку же полная сумма квадратов в обеих моделях одна и та же, отсюда и вытекает заявленное выше свойство коэффициента

в полной модели не может быть меньше, чем в редуцированной модели. Поскольку же полная сумма квадратов в обеих моделях одна и та же, отсюда и вытекает заявленное выше свойство коэффициента ![]() .

.

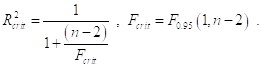

Чтобы сделать процедуру выбора модели с использованием ![]() Более приемлемой, было предложено использовать вместо

Более приемлемой, было предложено использовать вместо ![]() его Скорректированный (adjusted) вариант

его Скорректированный (adjusted) вариант

![]()

В который по-существу вводится Штраф За увеличение количества объясняющих переменных. При этом,

Так что

![]()

При ![]() и

и ![]() .

.

При использовании коэффициента ![]() для выбора между конкурирующими моделями, лучшей признается та, для которой этот коэффициент принимает Максимальное Значение.

для выбора между конкурирующими моделями, лучшей признается та, для которой этот коэффициент принимает Максимальное Значение.

Замечание. Если при сравнении полной и редуцированных моделей оценивание каждой из альтернативных моделей производится с использованием одного и того же количества наблюдений, то тогда, как следует из формулы, определяющей ![]() , сравнение моделей по величине

, сравнение моделей по величине ![]() равносильно сравнению этих моделей по величине

равносильно сравнению этих моделей по величине ![]() или по величине

или по величине ![]() . Только в последних двух случаях выбирается модель с Миниимальным Значением

. Только в последних двух случаях выбирается модель с Миниимальным Значением ![]() (или

(или ![]() ).

).

Пример. Продолжая последний пример, находим значения коэффициента ![]() при подборе моделей

при подборе моделей ![]() ,

,![]() ,

,![]() :

:

Для ![]() —

— ![]()

Для ![]() —

— ![]()

Для ![]() —

— ![]()

Таким образом, выбирая модель по максимуму ![]() , мы выберем из этих трех моделей именно модель

, мы выберем из этих трех моделей именно модель ![]() , к которой мы уже пришли до этого, пользуясь

, к которой мы уже пришли до этого, пользуясь ![]() - и

- и ![]() -критериями.

-критериями.

В этом конкретном случае сравнение всех трех моделей по величине ![]() не равносильно сравнению их по величине

не равносильно сравнению их по величине ![]() (или

(или ![]() ), если модели

), если модели ![]() ,

,![]() оцениваются по всем

оцениваются по всем ![]() Наблюдениям, представленным в таблице данных, тогда как модель

Наблюдениям, представленным в таблице данных, тогда как модель ![]() оценивается только по

оценивается только по![]() Наблюдениям (одно наблюдение теряется из-за отсутствия в таблице запаздывающего значения

Наблюдениям (одно наблюдение теряется из-за отсутствия в таблице запаздывающего значения ![]() , соответствующего

, соответствующего ![]() году).

году).

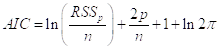

Наряду со скорректированным коэффициентом детерминации, для выбора между несколькими альтернативными моделями часто используют так называемые Информационные критерии: критерий Акаике И Критерий Шварца, также «штрафующие» за увеличение количества объясняющих переменных в модели, но несколько отличными способами.

Критерий Акаике (Akaike’s information criterion — AIC). При использовании этого критерия, линейной модели с ![]() объясняющими переменными, оцененной по

объясняющими переменными, оцененной по ![]() наблюдениям, сопоставляется значение

наблюдениям, сопоставляется значение

Где ![]() - остаточная сумма квадратов, полученная при оценивании коэффициентов модели методом наименьших квадратов. При увеличении количества объясняющих переменных первое слагаемое в правой части уменьшается, а второе увеличивается. Среди нескольких альтернативных моделей (полной и редуцированных) предпочтение отдается модели с наименьшим значением

- остаточная сумма квадратов, полученная при оценивании коэффициентов модели методом наименьших квадратов. При увеличении количества объясняющих переменных первое слагаемое в правой части уменьшается, а второе увеличивается. Среди нескольких альтернативных моделей (полной и редуцированных) предпочтение отдается модели с наименьшим значением ![]() , в которой достигается определенный компромисс между величиной остаточной суммы квадратов и количеством объясняющих переменных.

, в которой достигается определенный компромисс между величиной остаточной суммы квадратов и количеством объясняющих переменных.

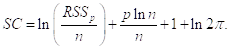

Критерий Шварца (Schwarz’s information criterion — SC, SIC). При использовании этого критерия, линейной модели с ![]() объясняющими переменными, оцененной по

объясняющими переменными, оцененной по ![]() наблюдениям, сопоставляется значение

наблюдениям, сопоставляется значение

И здесь при увеличении количества объясняющих переменны![]() Х первое слагаемое в правой части уменьшается, а второе увеличивается. Среди нескольких альтернативных моделей (полной и редуцированных) предпочтение отдается модели с наименьшим значением.

Х первое слагаемое в правой части уменьшается, а второе увеличивается. Среди нескольких альтернативных моделей (полной и редуцированных) предпочтение отдается модели с наименьшим значением.

Пример. В последнем примере получаем для полной модели ![]() и редуцированных моделей

и редуцированных моделей ![]() и

и ![]() следующие значения

следующие значения ![]() и

и ![]() .

.

|

AIC |

SC | |

|

M1 |

8.8147 |

8.9594 |

|

M2 |

8.6343 |

8.7428 |

|

M3 |

8.4738 |

8.5462 |

Предпочтительной по обоим критериям оказывается опять модель ![]() .

.

Замечание. В рассмотренном примере все три критерия ![]() ,

,![]() и

и ![]() выбирают одну и ту же модель. В общем случае подобное совпадение результатов выбора вовсе не обязательно.

выбирают одну и ту же модель. В общем случае подобное совпадение результатов выбора вовсе не обязательно.

Включение в модель большого количества объясняющих переменных часто приводит к ситуации, которую называют Мультиколлинеарностью.

Мы обещали ранее коснуться Проблемы мультиколлинеарности и сейчас выполним это обещание. Прежде всего напомним наше предположение

(4) Матрица XTX невырождена, Т. е. ее Определитель отличен от нуля:

![]()

Которое можно заменить условием

(4’) Столбцы матрицы X линейно независимы.

Полная мультиколлинеарность Соответствует случаю, когда предположение (4) нарушается, т. е. когда столбцы матрицы ![]() линейно зависимы, например,

линейно зависимы, например,

![]()

(![]() -й столбец является линейной комбинацией остальных столбцов матрицы

-й столбец является линейной комбинацией остальных столбцов матрицы ![]() ). При наличии чистой мультиколлинеарности система нормальных уравнений не имеет единственного решения, так что оценка наименьших квадратов для вектора параметров (коэффициентов) попросту не определена однозначным образом.

). При наличии чистой мультиколлинеарности система нормальных уравнений не имеет единственного решения, так что оценка наименьших квадратов для вектора параметров (коэффициентов) попросту не определена однозначным образом.

На практике, указывая на Наличие мультиколлинеарности, имеют в виду осложнения со статистическими выводами в ситуациях, когда формально условие (4) выполняется, но при этом определитель матрицы XTX Близок к нулю. Указанием на то, что ![]() -я объясняющая переменная «почти является» линейной комбинацией остальных объясняющих переменных, служит большое значение Коэффициента возрастания дисперсии

-я объясняющая переменная «почти является» линейной комбинацией остальных объясняющих переменных, служит большое значение Коэффициента возрастания дисперсии

![]()

Оценки коэффициента при этой переменной вследствие наличия такой «почти линейной» зависимости между этой и остальными объясняющими переменными. Здесь ![]() - коэффициент детерминации при оценивании методом наименьших квадратов модели

- коэффициент детерминации при оценивании методом наименьших квадратов модели

![]()

Если ![]() , то

, то ![]() , и это соответствует некоррелированности

, и это соответствует некоррелированности ![]() -ой переменной с остальными переменными. Если же

-ой переменной с остальными переменными. Если же ![]() , то тогда

, то тогда ![]() , и чем больше корреляция

, и чем больше корреляция ![]() -ой переменной с остальными переменными, тем в большей мере возрастает дисперсия оценки коэффициента при

-ой переменной с остальными переменными, тем в большей мере возрастает дисперсия оценки коэффициента при ![]() -ой переменной по сравнению с минимально возможной величиной этой оценки.

-ой переменной по сравнению с минимально возможной величиной этой оценки.

Мы можем аналогично определить коэффициент возрастания дисперсии ![]() оценки коэффициента при

оценки коэффициента при ![]() -ой объясняющей переменной для каждого

-ой объясняющей переменной для каждого ![]() :

:

![]()

Здесь ![]() — коэффициент детерминации при оценивании методом наименьших квадратов модели линейной регрессии

— коэффициент детерминации при оценивании методом наименьших квадратов модели линейной регрессии ![]() -ой объясняющей переменной на остальные объясняющие переменные. Слишком большие значения коэффицентов возрастания дисперсии указывают на то, что статистические выводы для соответствующих объясняющих переменных могут быть весьма неопределенными: доверительные интервалы для коэффициентов могут быть слишком широкими и включать в себя как положительные, так и отрицательные значения, что ведет в конечном счете к признанию коэффициентов при этих переменных статистически незначимыми при использовании

-ой объясняющей переменной на остальные объясняющие переменные. Слишком большие значения коэффицентов возрастания дисперсии указывают на то, что статистические выводы для соответствующих объясняющих переменных могут быть весьма неопределенными: доверительные интервалы для коэффициентов могут быть слишком широкими и включать в себя как положительные, так и отрицательные значения, что ведет в конечном счете к признанию коэффициентов при этих переменных статистически незначимыми при использовании ![]() - критериев.

- критериев.

Пример. Обращаясь опять к данным об импорте товаров и услуг во Францию, находим:

![]()

Коэффициенты возрастания дисперсии для переменных ![]() и

и ![]() совпадают вследствие совпадения коэффициентов детерминации регрессии переменной

совпадают вследствие совпадения коэффициентов детерминации регрессии переменной ![]() на переменные

на переменные ![]() и

и ![]() и регресии переменной

и регресии переменной ![]() на переменные

на переменные ![]() и

и ![]() (взаимно обратные регрессии).

(взаимно обратные регрессии).

Полученные значения коэффициентов возрастания дисперсий отражают очень сильную коррелированность переменных ![]() и

и ![]() . (Выборочный коэффициент корреляции между этими переменными равен

. (Выборочный коэффициент корреляции между этими переменными равен ![]() .)

.)

При наличии мультиколлинеарности может оказаться невозможным правильное разделение влияния отдельных объясняющих переменных. Удаление одной из переменных может привести к хорошо оцениваемой модели. Однако оставшиеся переменные примут на себя дополнительную нагрузку, так что коэффициент при каждой из этих переменных измеряет уже не собственно влияние этой переменной на объясняемую переменную, а учитывает также и часть влияния исключенных переменных, коррелированных с данной переменной.

Пример. Продолжая последний пример, рассмотрим редуцированные модели, получамые исключением из числа объясняющих переменных переменной ![]() или переменной

или переменной ![]() . Оценивание этих моделей приводит к следующим результатам:

. Оценивание этих моделей приводит к следующим результатам:

![]()

C ![]() и

и ![]() для коэффициента при

для коэффициента при ![]() ;

;

![]()

C ![]() и

и ![]() для коэффициента при

для коэффициента при ![]() .

.

В каждой из этих двух моделей коэффициенты при ![]() и

и ![]() имеют очень высокую статистическую значимость. В первой модели изменчивость переменной

имеют очень высокую статистическую значимость. В первой модели изменчивость переменной ![]() объясняет

объясняет ![]() изменчивости переменной

изменчивости переменной ![]() ; во второй модели изменчивость переменной

; во второй модели изменчивость переменной ![]() объясняет

объясняет ![]() изменчивости переменной

изменчивости переменной ![]() . С этой точки зрения, переменные

. С этой точки зрения, переменные ![]() и

и ![]() вполне заменяют друг друга, так что дополнение каждой из редуцированных моделей недостающей объясняющей переменной практически ничего не добавляя к объяснению изменчивости

вполне заменяют друг друга, так что дополнение каждой из редуцированных моделей недостающей объясняющей переменной практически ничего не добавляя к объяснению изменчивости ![]() (в полной модели объясняется

(в полной модели объясняется ![]() изменчивости переменной

изменчивости переменной ![]() ), в то же время приводит к неопределенности в оценивании коэффициентов при

), в то же время приводит к неопределенности в оценивании коэффициентов при ![]() и

и ![]() .

.

Но коэффициент при ![]() в полной модели соответствует связи между переменными

в полной модели соответствует связи между переменными ![]() и

и ![]() , очищенными от влияния переменной

, очищенными от влияния переменной ![]() , тогда как коэффициент при

, тогда как коэффициент при ![]() в полной модели соответствует связи между переменными

в полной модели соответствует связи между переменными ![]() и

и ![]() , очищенными от влияния переменной

, очищенными от влияния переменной ![]() . Поэтому неопределенность в оценивании коэффициентов при

. Поэтому неопределенность в оценивании коэффициентов при ![]() и

и ![]() в полной модели по-существу означает невозможность разделения эффектов влияния переменных

в полной модели по-существу означает невозможность разделения эффектов влияния переменных ![]() и

и ![]() на переменную

на переменную ![]() .

.

Приведем значения ![]() ,

,![]()

![]() и

и ![]() для всех трех моделей.

для всех трех моделей.

|

|

|

|

| |

|

Полная |

0.9702 |

1.1324 |

3.274 |

3.411 |

|

Без |

0.9704 |

1.1286 |

3.211 |

3.303 |

|

Без |

0.9719 |

1.0991 |

3.158 |

3.250 |

Все четыре критерия выбирают в качестве наилучшей модель с исключенной переменной ![]() .

.

Мы не будем далее углубляться в проблему мультиколлинеарности, обсуждать другие ее последствия и возможные способы преодоления затруднений, связанных с мультиколлинеарностью. Заинтересованный читатель может обратиться по этому вопросу к более полным руководствам по эконометрике.

| < Предыдущая | Следующая > |

|---|